Как создать RAG-систему, которую компании действительно используют: от концепции к продакшену

Создайте RAG-систему для продакшена: избегните ошибок 70% компаний. От теории к рабочему решению с гарантированной точностью и масштабируемостью.

Каждую неделю очередная компания объявляет о своей новой AI-инициативе на основе RAG (Retrieval-Augmented Generation). Однако согласно последним данным, 70% внедрений RAG не оправдывают возложенных на них надежд. Они страдают от проблем с точностью, масштабируемостью, задержками или дают нестабильные результаты, непригодные для продакшена.

В чём разница между демо, которое впечатляет руководство, и системой, которая обрабатывает реальные запросы клиентов в масштабе? В понимании того, что заставляет RAG-системы ломаться — и в создании защиты от этих сбоев с первого дня.

Реальность RAG

Проще говоря: RAG объединяет интеллект больших языковых моделей с конкретными знаниями вашей компании. Вместо обучения собственной AI-модели (дорого и долго), вы даёте существующей модели вроде GPT-4 или Claude доступ к вашим документам, базам данных и внутренним знаниям.

Представьте, что вы наняли блестящего консультанта, который может мгновенно получить доступ и понять каждый документ в вашей компании. Обещание заманчиво — точные, контекстные ответы на основе ваших реальных данных.

Реальные цифры: Создание собственной LLM может стоить $2-10 миллионов и занять 6-12 месяцев. Хорошо реализованная RAG-система может быть готова к продакшену за 4-8 недель при затратах $50-200k.

Но вот где компании спотыкаются. Они видят демо, где система правильно отвечает на вопрос "Какова наша политика возврата?" и спешат в продакшен. Шесть месяцев спустя система уверенно сообщает клиентам неверную информацию, извлекает нерелевантные документы или тратит 30 секунд на ответ.

Почему RAG-системы не работают в продакшене

Ловушка качества данных

Согласно отраслевому анализу, основная причина неудач RAG-систем — это отношение к подготовке данных как к одноразовой задаче. Команды загружают документы в векторную базу данных и считают дело сделанным.

Что происходит на самом деле: Ваша обработка PDF пропускает таблицы. Ваш HTML-парсер включает навигационные меню в описания продуктов. Ваш алгоритм разбиения разделяет критический контекст по границам.

Как отмечено в производственных кейсах, успешные системы относятся к подготовке данных как к непрерывному, сложному процессу. Они реализуют семантическое разбиение, которое сохраняет контекстные границы, а не произвольные лимиты символов. Это означает анализ структуры документа и обеспечение того, чтобы каждый фрагмент содержал законченные мысли.

Вот что мы рекомендуем: Перед обработкой 10 000 документов вручную просмотрите 100. Ищите крайние случаи — таблицы, блоки кода, сноски. Стройте свой конвейер так, чтобы он правильно обрабатывал их с самого начала.

Проблема задержек, о которой никто не говорит

RAG вводит дополнительные задержки из-за этапа извлечения. По мере роста вашего корпуса документов извлечение замедляется, особенно если базовая инфраструктура не может адекватно масштабироваться.

Честное мнение: Тот отклик меньше секунды в вашем демо? Добавьте сетевую задержку, поиск в базе данных, генерацию эмбеддингов и обработку LLM. Внезапно вы на уровне 5-10 секунд на запрос.

Согласно исследованию IBM, успешные внедрения используют следующие стратегии:

- Векторное квантование для уменьшения размерности векторных представлений

- Предварительная фильтрация с помощью поиска по ключевым словам перед плотным извлечением для сокращения пространства поиска

- Семантическое кэширование для часто задаваемых вопросов

- Многоступенчатое ранжирование с быстрым начальным извлечением и последующим точным переранжированием

Ключевой вывод для бизнеса: Каждая секунда задержки стоит конверсий. Планируйте бюджет на правильную инфраструктуру с самого начала, а не как запоздалую мысль.

Кризис качества извлечения

Ваша RAG-система настолько хороша, насколько хороши документы, которые она извлекает. Согласно анализу Databricks, "Мой извлекатель возвращает нерелевантные документы" — одна из пяти главных проблем, с которыми сталкиваются команды.

Коренная причина? Большинство команд используют единую стратегию извлечения для всех запросов. Но разные вопросы требуют разных подходов:

- Технические спецификации нуждаются в точных совпадениях по ключевым словам

- Концептуальные вопросы выигрывают от семантического сходства

- Многоэтапные проблемы требуют извлечения связанных документов

Как отмечено в производственных внедрениях, гибридный поиск, сочетающий плотные эмбеддинги с разреженными векторами (например, BM25), значительно улучшает качество извлечения. Инструменты вроде Qdrant и Weaviate поддерживают это из коробки.

Что это означает для вашего проекта: Не выбирайте векторную базу данных на основе маркетинга. Тестируйте с вашими реальными данными и паттернами запросов.

Создание RAG, который действительно работает

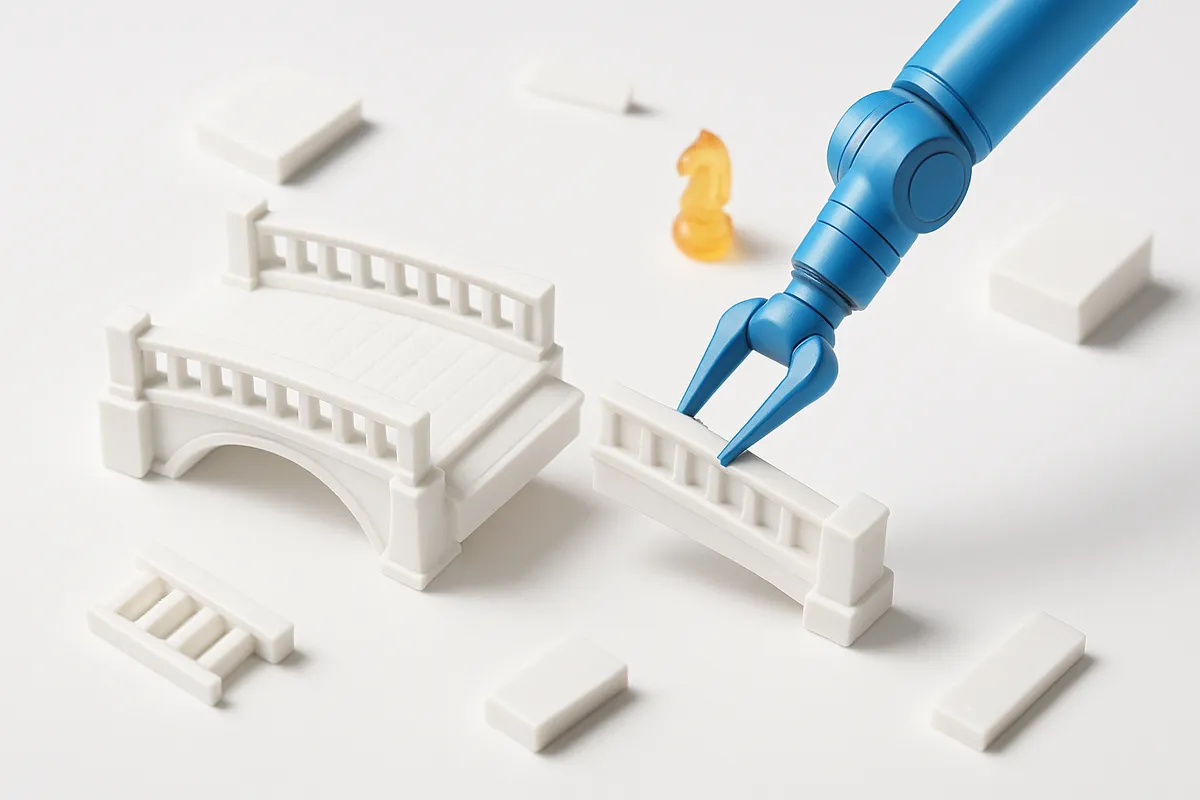

Начните с правильной архитектуры

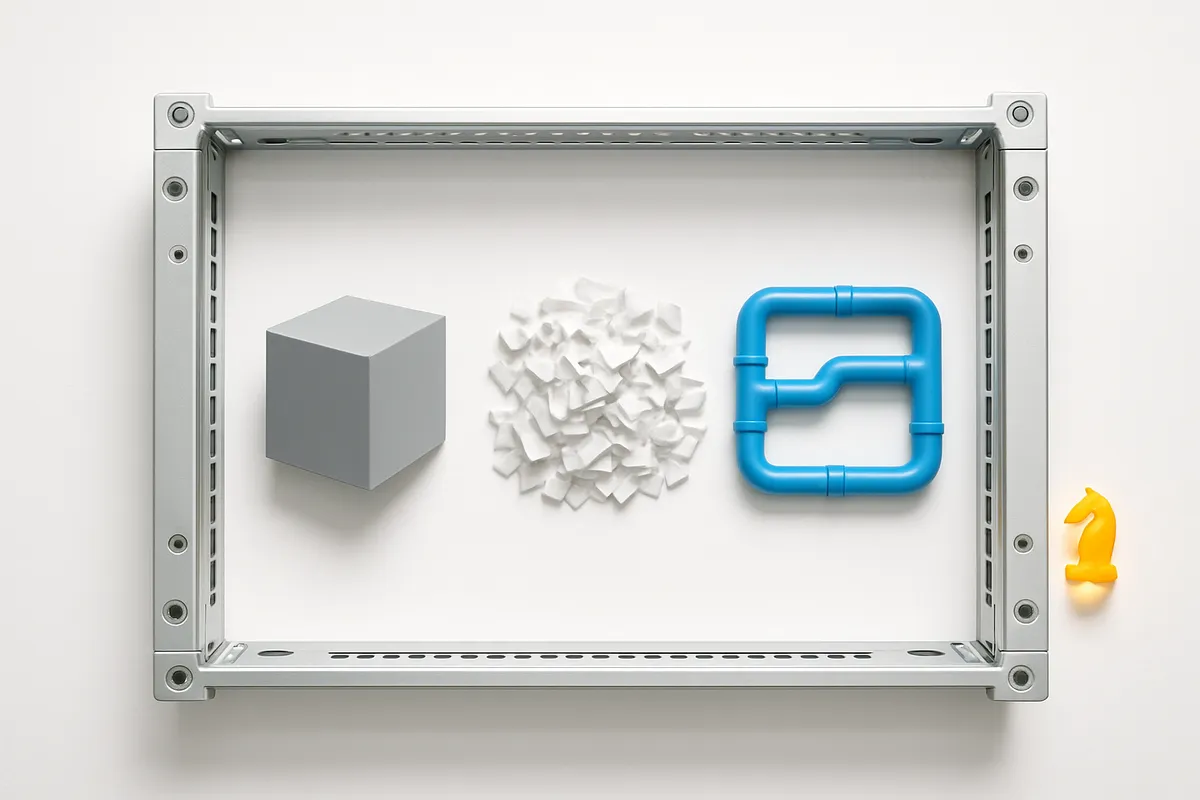

На основе анализа успешных производственных систем, каждой корпоративной RAG-системе необходимы четыре обязательных слоя:

- Слой данных: Не просто хранение, а интеллектуальная обработка

- Модельный слой: Эмбеддинги, модели извлечения и генерации

- Слой развертывания: Масштабируемая инфраструктура с надлежащим мониторингом

- Оркестрация приложений: Управление сложным конвейером

Согласно недавнему анализу фреймворков, команды могут выбирать между собственным кодом (полный контроль) или фреймворками вроде LangChain и LlamaIndex (более быстрая разработка). Выбор зависит от экспертизы вашей команды и потребностей в кастомизации.

По нашему опыту 50+ проектов: Начинайте с фреймворков для прототипирования, но будьте готовы заменить компоненты собственным кодом при масштабировании. Фреймворки помогают понять, что вам нужно, но продакшен часто требует тонко настроенного контроля.

Конвейер данных, который создаёт или ломает вас

Успешные внедрения RAG имеют общие практики работы с данными:

Продвинутые стратегии разбиения: Как отмечено в руководствах по продакшену, технический контент требует сохранения блоков кода целыми и использования разумных разделителей с перекрытием. Финансовым документам может потребоваться обработка с учётом таблиц. Юридические тексты требуют сохранения контекста цитат.

Непрерывный мониторинг качества: Согласно кейсам, производственные системы реализуют отдельные вызовы LLM для проверки того, что сгенерированные ответы основаны на извлечённом контексте. Если валидация не проходит, они перегенерируют или эскалируют к людям.

Динамическая обработка запросов: Анализ Medium подчёркивает, что динамическое перевзвешивание запросов на основе контекста пользователя значительно улучшает глубину извлечения. Это означает, что ваша система учится, какие термины наиболее важны для разных типов пользователей.

Оптимизация производительности, которая имеет значение

Оптимизация токенов — это не только о стоимости, но и о задержках и точности. Производственные системы сжимают извлечённый контекст путём:

- Удаления избыточности в извлечённых фрагментах

- Использования экстрактивного суммирования для длинных отрывков

- Удаления ненужного форматирования и метаданных

Согласно исследованиям производительности, эти оптимизации могут сократить использование токенов на 40-60% при сохранении или улучшении качества ответов.

Реальные цифры: Компания финансовых услуг снизила стоимость запроса с $0,15 до $0,06, улучшив время ответа с 8 секунд до 3 секунд через систематическую оптимизацию.

Безопасность и соответствие требованиям — скрытая сложность

Как отмечает Databricks, RAG-приложения могут извлекать "конфиденциальные данные, к которым пользователи не должны иметь доступа". Это не баг — это архитектурная проблема.

Производственные системы реализуют:

- Контроль доступа на уровне документов, синхронизированный с исходными системами

- Журналирование запросов для соответствия требованиям без хранения конфиденциальных данных

- Фильтрация результатов на основе разрешений пользователей

- Аудит-треки для отслеживания происхождения данных

Честное мнение: Безопасность — это не дополнительная функция. Если вы работаете с конфиденциальными данными, встройте контроль доступа в вашу начальную архитектуру или готовьтесь к перестройке позже.

Стратегии внедрения, которые работают

Выбирайте инструменты мудро

На основе анализа экосистемы инструментов:

Векторные базы данных: Pinecone для управляемых решений, Chroma для экспериментов, Weaviate или Qdrant для нужд гибридного поиска. Ваш выбор зависит от масштаба, бюджета и требований к контролю.

Модели эмбеддингов: text-embedding-ada-002 от OpenAI для общего использования, Sentence Transformers для специализированных доменов. Тестируйте с вашим реальным контентом — доменно-специфичные модели часто превосходят общие.

Выбор LLM: GPT-4 и Claude для сложных рассуждений, меньшие модели для простого извлечения. Ключ в соответствии возможностей модели требованиям задачи.

Стратегия тестирования, которую все пропускают

Согласно производственным кейсам, успешные команды внедряют:

- Тестирование золотого набора данных: 100-500 вручную проверенных пар вопрос-ответ

- Регрессионное тестирование: Обеспечение того, что улучшения не ломают существующую функциональность

- Нагрузочное тестирование: Имитация одновременных пользователей для выявления узких мест

- Состязательное тестирование: Попытки заставить систему предоставить неверную информацию

Ключевой вывод для бизнеса: Тестирование не опционально. Планируйте 30-40% времени разработки на комплексное тестирование или планируйте 300% на исправление производственных проблем.

Как заставить RAG работать для вашего бизнеса

Начинайте с малого, масштабируйтесь с умом

Команды, которые преуспевают с RAG, следуют предсказуемому паттерну:

- Пилотный проект: 100-500 документов, единственный юз-кейс, ограниченные пользователи

- Измеренное расширение: Добавление документов и юз-кейсов на основе метрик успеха

- Производственное масштабирование: Полное внедрение с надлежащей инфраструктурой

Этот подход позволяет вам изучить особенности ваших данных, понять поведение пользователей и создать экспертизу команды без ставок на всю компанию.

Бюджет для реальности, а не демо

Реальные цифры из производственных внедрений:

- Начальная разработка: $50-200k

- Инфраструктура (первый год): $20-100k в зависимости от масштаба

- Обслуживание и обновления: 20-30% от начальной стоимости ежегодно

- Подготовка данных часто занимает 40-60% общего времени разработки

Метрики успеха, которые имеют значение

Согласно производственным внедрениям, отслеживайте:

- Точность извлечения: Находятся ли правильные документы?

- Точность ответов: Проверенная против вашего золотого набора данных

- Время ответа: 95-й процентиль, а не среднее

- Доверие пользователей: Через обратную связь и паттерны использования

- Стоимость за запрос: Включая всю инфраструктуру и стоимость API

Что это означает для вашего проекта: Определите метрики успеха до создания. "Она должна правильно отвечать на вопросы" — это не метрика. "95% точность на нашем золотом наборе данных с временем ответа <3 секунды" — это метрика.

Путь вперёд

Создание RAG-системы, которую компании действительно используют, требует понимания того, что демо — это только начало. Успех приходит от:

- Отношения к качеству данных как к непрерывному процессу, а не одноразовой задаче

- Создания с учётом задержек и масштаба с первого дня

- Внедрения надлежащего тестирования и мониторинга до продакшена

- Выбора инструментов на основе ваших реальных потребностей, а не маркетинговых обещаний

Вот что мы рекомендуем: Начните с сфокусированного пилотного проекта. Измеряйте всё. Будьте готовы итерировать ваш конвейер данных больше, чем выбор модели. Встройте безопасность и соответствие требованиям в вашу архитектуру, а не как запоздалую мысль.

30% внедрений RAG, которые преуспевают, имеют одну общую черту: они уважают сложность, сохраняя фокус на бизнес-ценности. Ваша база знаний может содержать миллионы документов, но если система не может точно и быстро ответить на топ-10 вопросов ваших клиентов, вы не создали то, что компании действительно используют.

Проще говоря: RAG — это не о технологии, а о надёжном соединении ваших пользователей с информацией, которая им нужна. Всё остальное — детали реализации.

Часто задаваемые вопросы

Как оценить, действительно ли RAG-система работает для вашего реального юз-кейса?

Создайте золотой набор данных из 100-500 реальных вопросов из вашего домена с проверенными ответами. Тестируйте вашу систему против этого набора еженедельно, отслеживая точность, полноту и точность ответов. Также мониторьте обратную связь пользователей и журналы запросов для выявления паттернов, где система даёт сбои.

Какой лучший способ разбивать и хранить документы для корпоративных RAG-систем с 20K+ документами?

Используйте семантическое разбиение, которое уважает структуру документа — сохраняя таблицы, блоки кода и связанные параграфы вместе. Реализуйте перекрытие между фрагментами (10-20%) для сохранения контекста. Храните как фрагменты, так и метаданные документов в вашей векторной базе данных, позволяя фильтрованный поиск по типу документа, дате или департаменту.

Как предотвратить уверенные, но неверные ответы RAG-системы, которые разрушают доверие пользователей?

Реализуйте валидацию ответов через отдельный вызов LLM, который проверяет ответы против извлечённых источников. Включите оценки уверенности в ваш конвейер и установите пороги для эскалации к людям. Обучите ваши промпты генерации выражать неуверенность, когда извлечённый контекст не полностью поддерживает ответ.